分享到:

- 微信

- 微博

AI帮你提炼, 10秒看完要点

智能挖掘相关板块, 定位投资机会

AI速读

节省{{readTime}}分钟阅读时间 {{aisd}}

AI生成 免责声明

华泰证券:DeepSeek有望加速模型训练与CUDA解耦

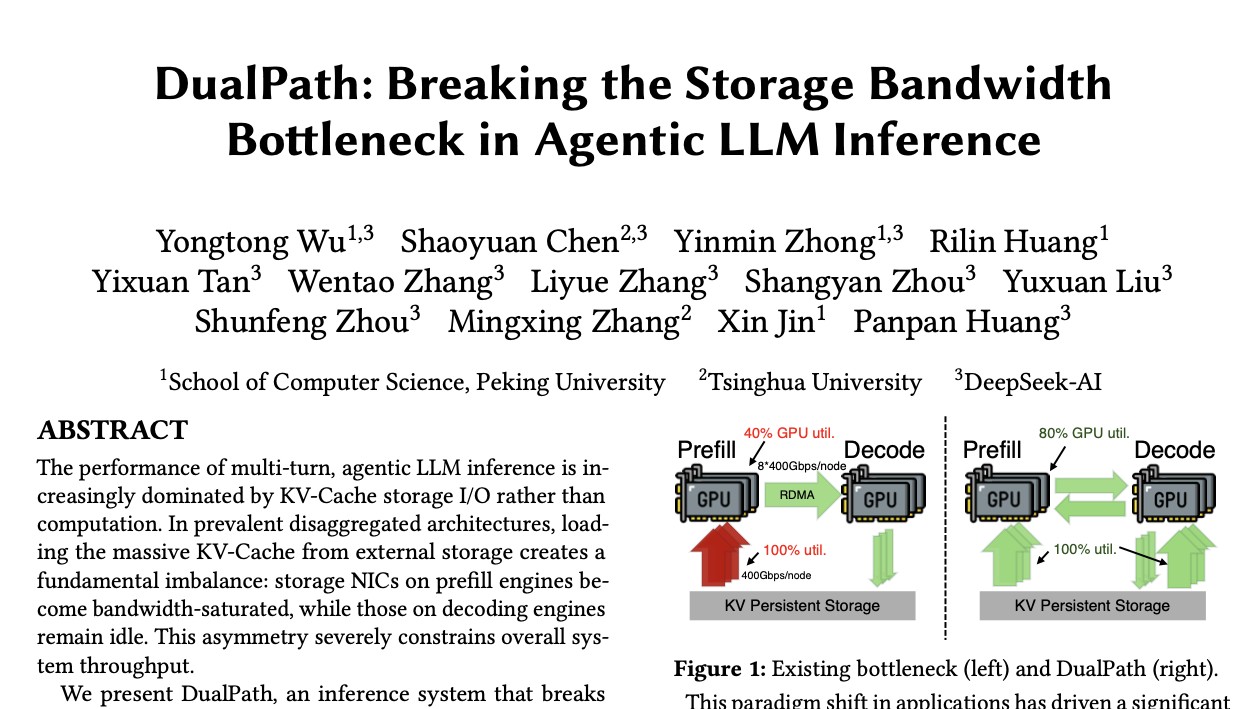

华泰证券研究认为,DeepSeek在V3中使用了相比CUDA更底层的PTX 来优化硬件算法,PTX是CUDA编译的中间代码,在CUDA和最终机器码之间起到桥梁作用。而NSA则使用了OpenAl提出的Triton编程语言高效编写GPU代码,Triton的底层可调用CUDA,也可调用其他GPU语言,包括AMD的rocm以及国产算力芯片语言,如寒武纪的思元590芯片和海光信息的深算一号(DCU)内置的HYGON ISA指令集。LLM的训练短期内虽未完全脱离CUDA 生态,但DeepSeek NSA的推出使其初步呈现出与CUDA解耦的趋势,并为后续适配更多类型的算力芯片奠定基础。以异腾为代表的国产算力已经很好的适配了DeepSeek-R1 等国产模型,并取得了高效推理的效果,华泰证券认为,伴随海外算力的受限,针对国产算力的优化或将有持续进展,值得重视。

举报

第一财经广告合作,请点击这里

此内容为第一财经原创,著作权归第一财经所有。未经第一财经书面授权,不得以任何方式加以使用,包括转载、摘编、复制或建立镜像。第一财经保留追究侵权者法律责任的权利。如需获得授权请联系第一财经版权部:banquan@yicai.com

相关阅读

IBM中国高管:软件行业的DeepSeek时刻还没来

IBM认为市场低估了企业级应用的“复杂度”。

DeepSeek又一论文上新!新模型V4更近了?

论文延续DeepSeek一贯的风格,在工程化层面将性能优化推向极致。

AI进化速递丨DeepSeek发布DeepSeek-OCR 2模型

阿里正式发布千问旗舰推理模型Qwen3-Max-Thinking、微软推出下一代AI芯片Maia 200芯片……

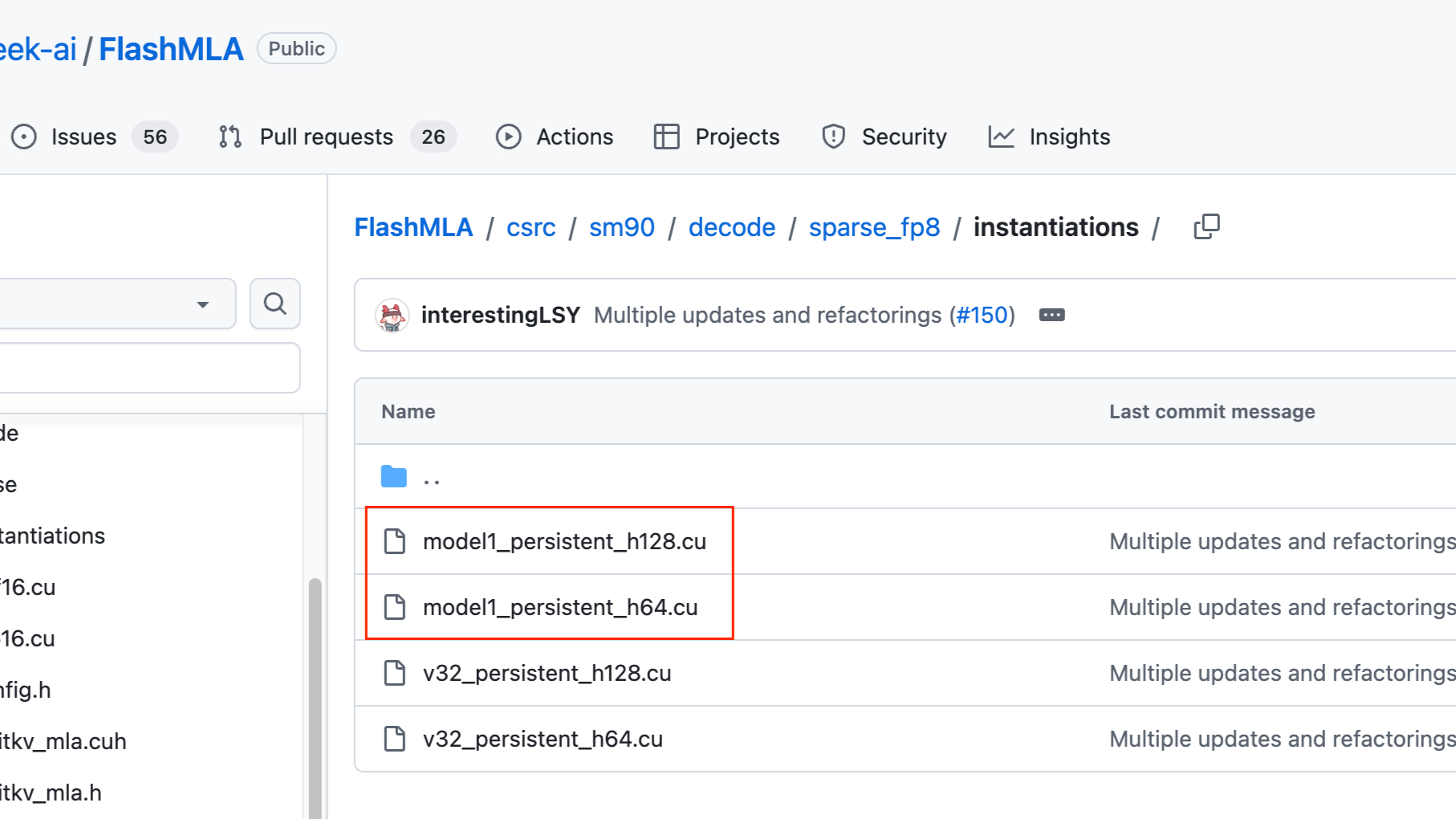

DeepSeek新模型真的要来了?“MODEL1”曝光

“MODEL1”很可能已接近训练完成或推理部署阶段。

DeepSeek论文上新!下一代大模型实现“记忆分离”,V4不远了?

业内猜测这或许就是DeepSeek V4的研究路线图。

一财最热