分享到:

- 微信

- 微博

{{aisd}}

AI生成 免责声明

随着AI大模型的应用越发普遍,如何确保其使用过程中的安全性、合规性,成为基金行业关注的焦点。

4月3日,中国证券投资基金业协会(下称“基金业协会”)发布公告称,根据相关规定,协会组织制定了《基金经营机构大模型技术应用规范》(T/AMAC 0004-2026,下称《应用规范》),经协会理事会审议通过并正式发布,自公布之日起实施。

这是基金行业首个针对大模型技术应用的团体标准。第一财经记者注意到,文件起草单位除基金业协会外,还包括易方达基金、中金财富、工银瑞信基金、华夏基金、九坤投资等国内头部公私募机构,以及阿里云、智谱华章、华为等知名大模型技术提供商,还有中国信息通信研究院等智库单位。

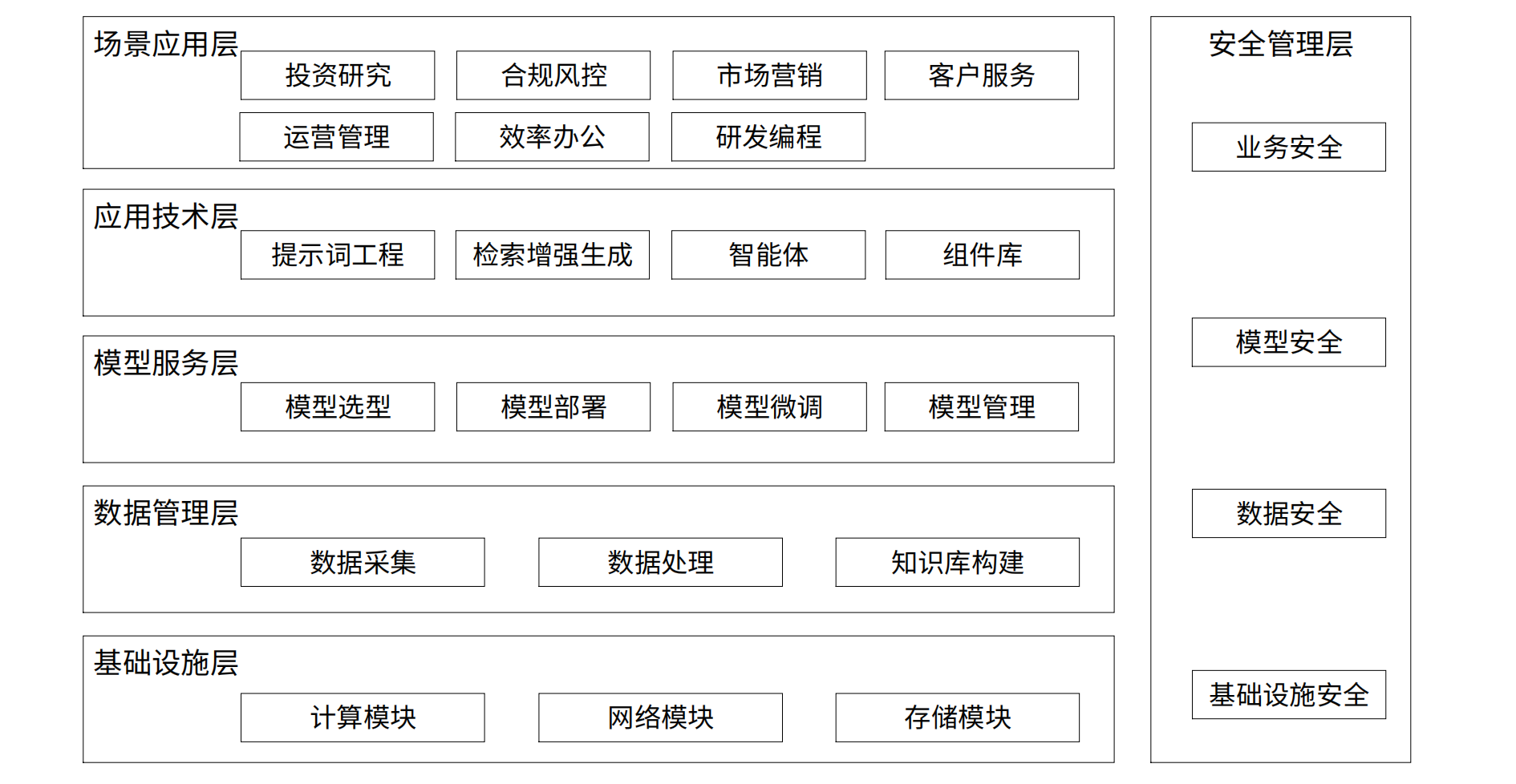

《应用规范》将大模型技术在资产管理业务中的应用划分为六个层次:基础设施、数据管理、模型服务、应用技术、安全管理以及场景应用,并对每一层次提出了具体的技术要求或管理措施。

四大维度保障应用安全

今年3月初,在市场掀起“养龙虾”(即部署OpenClaw等AI智能体工具)的热潮时,第一财经从多家公募基金了解到,由于担心安全隐患,基金公司已明确禁止工作人员在办公环境中部署相关工具。

“主要还是因为OpenClaw等AI智能体工具在运行中需申请高阶系统权限,存在固有的安全脆弱性,相关风险可能导致信息泄露、系统权限失控,进而对业务与数据安全造成严重影响。”某大型金融机构的首席技术官曾向第一财经表示。

这次发布的《应用规范》中,安全管理是篇幅最多、要求最细的部分,涵盖了基础设施、数据、模型与业务四个维度的安全问题。

其中在数据安全上,《应用规范》强调,“不应将未脱敏的客户个人信息、核心交易指令、投研未公开信息直接用于大模型的训练或微调”。对于高敏感等级的投研策略和风控规则数据,应仅允许在私有化部署、物理隔离或逻辑隔离的专用模型环境中进行训练或推理。

在模型安全方面,要求机构建立内容安全审查、对抗样本防护、供应链安全评估和模型访问权限隔离机制,确保模型输出的合规性、稳健性和可解释性。

对于业务安全,明确机构通过大模型生成合成内容标识和传播活动必须遵守《人工智能生成合成内容标识办法》的要求,并从身份多重认证、API接口防护、合规审计追溯和应急响应恢复等维度入手,全方位防范大模型应用的各类安全风险。

明确七大应用场景

在出于安全考量禁止部署的同时,基金行业也在积极拥抱大模型等新技术。第一财经此前了解到,部分头部公私募机构已组建专门的团队,探索此类Agent在投研领域应用的可能性。

本次发布的《应用规范》,为基金行业未来在哪些领域使用大模型技术指了一条“明路”,涵盖了投资研究、合规风控、市场营销、客户服务、运营管理、效率办公共七大场景。

仅从投资研究方向来看,《应用规范》对大模型技术应用的场景主要集中在信息提取、报表分析、舆情监控、因子挖掘等辅助领域。

一位头部公募的基金经理此前向第一财经表示,机构的交易系统均是封闭系统,意味着OpenClaw之类的大模型对于机构日常交易“基本上没什么意义”。但他也认为,用AI大模型完成处理海量数据和信息等基础的、重复性的工作仍是行业发展趋势,“AI在未来会替代很多研究员的工作”。

如需获得授权请联系第一财经版权部:banquan@yicai.com