分享到:

- 微信

- 微博

{{aisd}}

AI生成 免责声明

(本文作者张晓泉清华大学经济管理学院 Irwin and Joan Jacobs 讲席教授)

- 本文首发于一财号

大约在一年前,OpenAI的GPT-4重磅发布,即刻刷爆全网。「强大」、「颠覆」、「炸裂」、「变革」、「改变世界」、「未来已来」几乎是持续霸屏的关键词。

如今,OpenAI带着最新的研究成果Sora再度席卷而来。即便已经被GPT-4震撼过,从新闻报道和媒体的叙述中还是可以看出,Sora的亮相依然艳惊四座,令人拍案叫绝,比之GPT有过之而无不及。

仿佛一夜之间,AI圈已换了天地。此时也更加凸显出了人类语言是多么贫瘠且毫无新意,媒体对Sora的评价并没有跳脱出当初描述DALL-E或ChatGPT的关键词汇。

有关Sora的内容和讨论层出不穷,但大致可归为这样几类:

「震惊贴」:描述Sora的功能有多强大、多炫酷、多颠覆,哪些行业、职业将迎来机遇或面临挑战与威胁;

「技术贴」:分析和讨论Sora的技术原理、可能的应用、突破与缺陷;

「争辩贴」:这一类的话题最为广泛,主要包含技术原理、商业化、安全性等的讨论。

无论是哪一种内容,其庞大的信息量都让人目不暇接,再加上信息质量良莠不齐,不少人可能会越看越迷惑。因此,本文试图用更简单易懂的方式,去厘清围绕Sora的诸多问题与事件的整体脉络,尽量从多个视角去了解Sora。

Sora来了,AI圈大变天?

Sora的名字取自日语「天空」的寓意,象征着“无限的创造潜力”,它是OpenAI最新宣布的一款文本到视频的人工智能模型(text-to-video model),也有人将其视为文本转视频的GPT-3。

尽管OpenAI目前还没有正式发布Sora,但这也不妨碍该模型出场就以断层第一的实绩空降C位,仅凭demo视频就「吊打」同行的同类型产品(如Runway-Gen-2、Lumiere、Make-a-Video等),斩获一片「遥遥领先」的呼声。

根据OpenAI官网的“技术文档”介绍,Sora能够根据文本、图像、视频输入,生成(或合成、向前向后扩展、渲染)具有不同宽高比和分辨率的高质量、高保真度的1分钟视频(或高清图片),且生成的视频具有3D一致性、远程一致性、对象持久性以及环境交互等功能。

这些特性换句话说,就是符合真实世界或者说是人类视觉习惯的效果呈现。

在技术原理方面,OpenAI并没有过多透露,只是大而化之的描述了Sora是将Diffusion扩散模型(DALL-E 3)与transformer架构 (ChatGPT) 相结合。这种混合可以让模型处理视频(图像帧的时间序列),就像 ChatGPT 处理文本一样。

有关这项技术的更多内容和细节(如训练数据等)也都处于保密状态,因此网上有非常多Sora相关技术原理的讨论和猜测,但即便是AI专家也会给人一种令人眼花缭乱的感觉。

世界模型:从「激变」到「激辩」

在舆论场上,围绕Sora的辩论十分激烈,已然形成“百家争鸣”的局面。支持的、反对的、质疑的、观望的、蹭热度的……其中有各行业的专家、技术大牛、相关从业者、商界领袖等等。总结起来不外乎三点:

1)技术的完备性:准确性、因果关系等;

2)技术的安全性:隐私问题、伦理问题、版权问题、法律问题等;

3)技术的应用:商业化、行业前景等。

有些内容是AI领域老生常谈的,所以这里讲讲有趣且值得关注的话题。

Sora是否理解物理世界?世界是一个巨大的模型?

首先是OpenAI给Sora的定位,当中提到了「世界模拟器」(world simulator)的概念。OpenAI对此没有进行更多阐释,只是笼统的称其是“作为构建物理世界的视频生成模型”。

然而,这个概念对于理解Sora及其相关讨论非常重要,一些主要的争论也是围绕它展开。

比如Sora真的懂物理世界吗?

这个问题的争议点在于,Sora生成的视频往往让人眼前一亮,乍一看也接近现实,符合物理世界的规律,但只要仔细看就会发现它存在的不合理之处,这些错误在OpenAI发布的demo视频中都能找到。

比如四条腿的蚂蚁、反重力的椅子、突然出现和消失的物体、诡异的构造和运动方式、玻璃杯诡异的碎裂方式等。

这些缺陷明显都与OpenAI引以为傲的时空连续性和物体持久性不符,不免让人怀疑,Sora是真的理解物理世界,还是仅仅在关联和拼凑像素?

对于Sora作为「世界模拟器」的说法,图灵奖得主,Meta首席AI科学家Yann LeCun是最瞩目的公开反驳者,他直言“通过生成像素来模拟世界的行为,注定失败”。

长期活跃在AI领域的纽约大学心理学和神经科学名誉教授Gary Marcus也表达了类似的观点。

他以Sora视频中的错误为例,对OpenAI所谓的对象持久性提出了质疑,并表示“Sora不是一个迭代的、基于定律的物理引擎,而是一个粗暴的野兽”。

英伟达高级研究科学家Jim Fan对此进行了补充,提出了两个解释的角度:

(1)该模型可能根本没有学习并掌握物理知识,只是在拼凑像素;

(2)模型实现了一个内部物理引擎,但这个引擎还不够好,就像虚幻引擎 v1,在流体和可变形等方面的物理模拟要比v5差很多,渲染也要差得多,而且不符合物理规律。

与之相反的另一派,则是将Sora这类新成果等同于通用人工智能(Artificial General Intelligence,AGI),或是将其视为实现AGI的一大捷径。

360创始人周鸿祎第一时间发了长文谈对Sora的看法,他认为Sora离AGI不远了,甚至大胆预测这不是10年20年的问题,可能一两年就能实现。

LeCun和周鸿祎的观点可以说是众多讨论中最主流的两类观点。我其实更偏向于LeCun的思路,周鸿祎说的这些也许是因为他不理解技术底层。

要明白「世界模拟器」是什么,得先了解AGI中「世界模型」(world model)这个关键概念。

「世界模型」是对现实或一个可能世界的图解表达,旨在增进人们对世界的理解和/或做出预测。

构建「世界模型」,就是在整体和细节上对世界进行建模或模拟、映射或复制,包括其性质和组成部分、结构和功能、状态和行为,涵盖所有层次和规模。

一般来说,「世界模型」是对整个现实的抽象表示。具体来说,它是对我们世界的空间或时间维度的抽象呈现。

「世界模型」是任何强大智能系统及其知识和学习、推理和行为以及与任何环境交互的关键。

人类使用「世界模型」作为大脑中的模拟器。该模型是通过环境中的交互从大量感觉运动数据中学习而获得的。

「世界模型」有双重作用:(1)估计感知未提供的有关世界状况的缺失信息,(2)预测世界未来可能的状态。

「世界模型」可以预测世界的自然演化,或预测由行为模块提出的一系列行动所导致的未来世界状态。

「世界模型」是与当前任务相关的那部分世界的模拟器。由于世界充满不确定性,模型必须能够表示多种可能的预测。

通常情况下,智能体会预测它希望世界变成什么样,然后采取行动以使该预测成为现实。在此过程中,智能体不断努力预测和理解周围环境,生成「世界模型」,以尽量减少目标或信念与环境(感官)证据之间的差异。

空间、时间和因果关系对于任何严肃的「世界模型」来说都是核心。

如果一个系统连对象的持久性都无法保证,是否应该将其称为「世界模拟器」?

而因果关系的错乱既是Sora的致命硬伤,也是Sora视频中存在各种荒谬错误的元凶。

简而言之,这是由于模型采用了计算概率分布的方法来对图像进行关联和拼接。问题就出在这里,仅凭处理自然语言文本上下文之间的连接概率,根本无法推导出全局的因果关系,整体的合理性就丢失了。

所以,概率统计的相关性并不能精确表达物理规律的因果性,这也是计算机与经济学最基本的区别。

在经济学领域,对因果推断的研究非常重视且由来已久。2021年诺贝尔经济学奖的其中一半,就是颁给了“对因果关系分析的方法学”作出贡献的Joshua D.Angrist和Guido W.Imbens。

这里需要特别指出的是,在Imbens的研究中,他尤其注意将大数据时代的机器学习等新方法吸收到因果推断的框架当中来,帮助改进因果推断的质量。同时,越来越多的经济学学者也正在将因果关系与机器学习相结合,用以检验长期以来在经济学界存在争议的问题。

从这个角度看,Sora今后的发展可能会需要用到经济学的这些理论和知识。

如果不能掌握因果关系,AI就不会很聪明。毕竟这是连人类都会遇到的麻烦,就连训练有素的科学家也容易将相关性误解为因果关系,或者反之。所以哪怕在合理的情况下,对于因果关系的指出也应该慎重。

就目前所见,Sora做的还是预测图像如何变化,而不是实体在现实中如何变化,这种推理路径并不是实现AGI所需的物理推理逻辑。

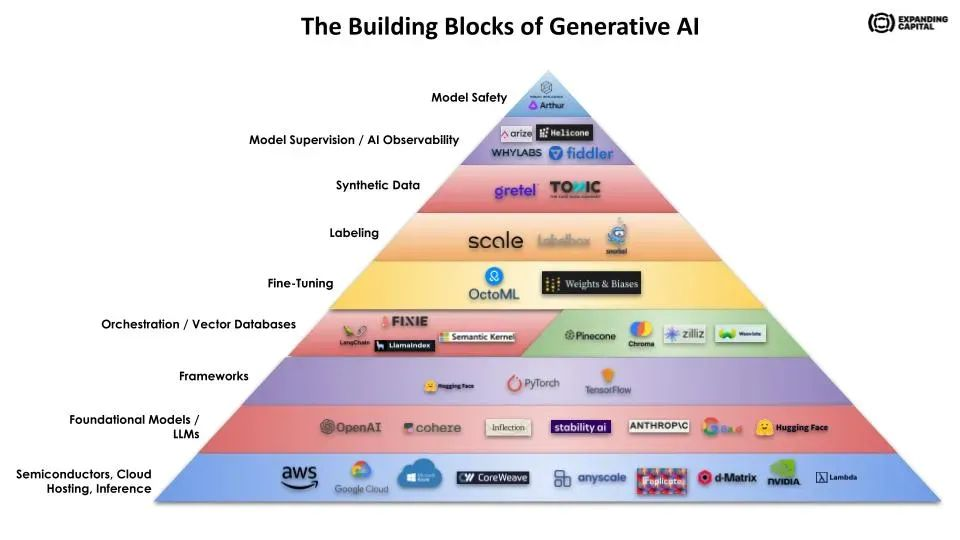

更直白一点说,Sora的技术突破并没有太大(语言大模型+图像大模型),但工程量超大,也就是用超强算力和超量数据去堆叠效果,基本上是一种以量取胜的思路。

这种方法的弊端也是显而易见的。首先,资源的消耗是巨大的,其次,对数据质量的要求是极高的。

这样一来,Sora领先同类模型的谜底其实早就写在了谜面上。

所谓的降维打击,一定程度上是数据、算力、自有模型等优势的加持,这也是目前手握三大模型(文+图+视频)的OpenAI超强的技术壁垒。

科技博主Gabor Cselle在其他模型上输入了Sora的起始帧,通过调试prompts和参数,使其输出与Sora相似的内容。结论是:Sora仅在较长的场景中表现更好。

Sora通过图像的联想和预测生成的视频或许伪造了一种真实感,但所有的故障都表明了这种伪造的局限性。这也是“Sora理解物理世界”的说法受到质疑的原因之一,因为它太容易被证伪了。

Sora展现出来的局限性,也是目前生成式AI模型的通病,类似于大语言模型产生的「幻觉」,可以改善,但很难根除。

纵然Sora有其强大可取之处,可是和ChatGPT一样,它们的底层都没有真正的理解能力。所以,Sora的成功可以看作是一场创新与规模的胜利,但将它等同于AGI未免过于乐观了些。

当AGI被反复提及,成为一种时髦的标签甚至沦为营销炒作的流量密码,各行业将其奉为万能灵药,然而大多数时候都是只看广告不管疗效。

既然是对最新科研成果的讨论,至少应该遵循基本的科学态度。

对一些底层概念和逻辑的理解,有助于更加客观理性地辨析Sora在AI发展中所处的阶段和层级,明白其突破意味着什么,也能看清它的不足与挑战。

狂欢之下,谁是赢家?

到目前为止,OpenAI已经创造了两个「奇迹」,且不论它们实际对世界改变了多少,从影响力的角度看,在生成式AI军备竞赛全面开启之后,OpenAI 已经以高调的姿态赢了两次,但它并不是唯一的受益者。

在AI产业变革的浪潮中,资本永远是嗅觉最灵敏的,业界的风吹草动都会反映在市场股价的走势上。

Sora声名大噪,几家欢喜几家愁,借着OpenAI掀起的这阵东风,有的乘风而起,有的随风下落。

凡是与AI相关的主题或概念,都有不同程度的上涨,而OpenAI的竞争对手以及可能被AI威胁的产业,则成为Sora的第一批受害者。

在Sora发布后的24小时内,AI相关的虚拟货币平均上涨了7.7%,其中,OpenAI的CEO山姆·奥特曼(Sam Altman)创立的世界币Worldcoin(WLD)涨幅最大,为30%。

AI的「神话」与「祛魅」

英国科幻小说家Arthur C. Clarke曾说:“足够先进的技术与魔法没有什么区别”。

Sora的出现无异于对世界施展了一次魔法,同时带动了科技、资本、营销、媒体等诸多领域的狂欢,制造了一个又一个奇观,但与ChatGPT发布时社交媒体的盛况相比,总给人一种昨日重现的错觉。

由于OpenAI一如既往地对Sora的大部分信息守口如瓶,有关Sora的争论也持续发酵并且愈演愈烈。

由于OpenAI一如既往地对Sora的大部分信息守口如瓶,有关Sora的争论也持续发酵并且愈演愈烈。

我在之前的一篇推送中也讲过(《顶流成名靠什么?》),利用或是刻意营造事物的“神秘感”,是营销炒作的一种手段。

“神秘感”加上“稀缺”的黄金组合,让Sora的刷屏传播变得无往不利,这时再追问OpenAI是否有意为之其实没有太大意义,因为效果显然已经足够好了。

说到保密,并不只是OpenAI被戏称为“CloseAI”,保密在硅谷也不是什么新鲜事,理由大概都是防止商业竞争或其技术危险扩散,或两者兼而有之。

斯坦福大学基础模型研究中心曾推出一项指数,用来衡量OpenAI、谷歌和Anthropic等10家科技巨头对人工智能的保密程度,下面是对它们透明度评级的结果。

大约十年前,科技和法律学者Frank Pasquale创造了“黑匣子社会”这个词,用来指科技平台为了巩固其在人们生活中的主导地位,因而变得越来越不透明。虽然人们对AI可能会产生的隐患存在种种担忧,但黑匣子已经成为常态,许多人也早已习惯了它的存在。

于是,在这一领域中,令人毛骨悚然的惊叹或是奇怪的半知半解是常见的现象。

自AI诞生以来,人们对它的想象往往是乌托邦或反乌托邦式的。面临强大而未知的事物,除了有种令人眩晕的力量感之外,或许还有一种屈辱的幻灭感。毕竟,这是人类使用过的最先进的技术。

AI领域的信息不透明,在一定程度上神化了它。新事物出现或是尚未被人类理解之前,都属于神秘领域,某种意义上就是神话。

面对神话叙事,人们要么膜拜要么恐惧,但这两种态度对于认识AI和推动其发展都无助益。正如市场中的过度狂热会产生泡沫,过度恐慌也会引发危机。对于Sora这类最新的研究成果,最好的应对方式就是既不过于神话也不轻易低估。

破除神话叙事和消除恐惧感的关键,在于打破或是减少信息差。

信息时代的大数据并没有帮助我们减少信息差,而生成式AI技术的发展,正在创造一个"影子被误认为是真实事物的世界"。在其助推之下,假消息和垃圾信息可能更加猖獗泛滥,进而加剧信息差的产生。也许未来,信息差会导致一种新型的贫富差异。

然而,在可见的将来,AI还会继续发展。在某些方面,人类已经被AI打败,未来将会怎样,没人能给出答案。

可以肯定的是,眼见为实早已成为历史。人类的认知方式也将随着AI的进化潜移默化地发生改变。

就拿ChatGPT和Sora来说,如果过去是先相信,再核查,今后就是先核查,再相信。

有网友调侃道:以后的普通人是不是只能吃着预制菜,读着ChatGPT生成的假新闻,看着AI写的剧本Sora生成的影视剧,戴着VR眼镜环游外太空,过上一种高科技低成本的赛博朋克生活,而真实自然的体验反而是最昂贵。

最后,借用麦克卢汉的几段话作为本文的结尾。

以未来主义和拟古主义为手段去迎战急剧变革,常常是徒劳无益的。指向昔日的马车时代也好,指向未来的抗重力运载工具也好,都不足以回答汽车的挑战。不过,这两种相同的向前看和向后看的方式,是避免眼前的经验中断而常用的方法。

鉴于人们面对挑战时有无穷无尽的力量使自己陷入无知无觉的催眠状态,我们可以认为,意志力在维护生存中与智力一样重要。今天,我们要做到信息灵通、见多识广,同样是需要意志力的。

当一个时代的技术向一个方向迅猛突进时,智慧完全可以召唤一种与之抗衡的反冲击。

(本文作者张晓泉清华大学经济管理学院 Irwin and Joan Jacobs 讲席教授)

本文仅代表作者观点。